PANGANDARAN – Kemajuan teknologi kecerdasan buatan (AI) kini membawa ancaman baru yang kian nyata: Deepfake. Jika dulu kita percaya bahwa melihat adalah mempercayai, kini rekaman video call dengan wajah dan suara orang yang kita kenal pun bisa jadi hanyalah manipulasi digital yang dirancang untuk menguras kantong Anda.

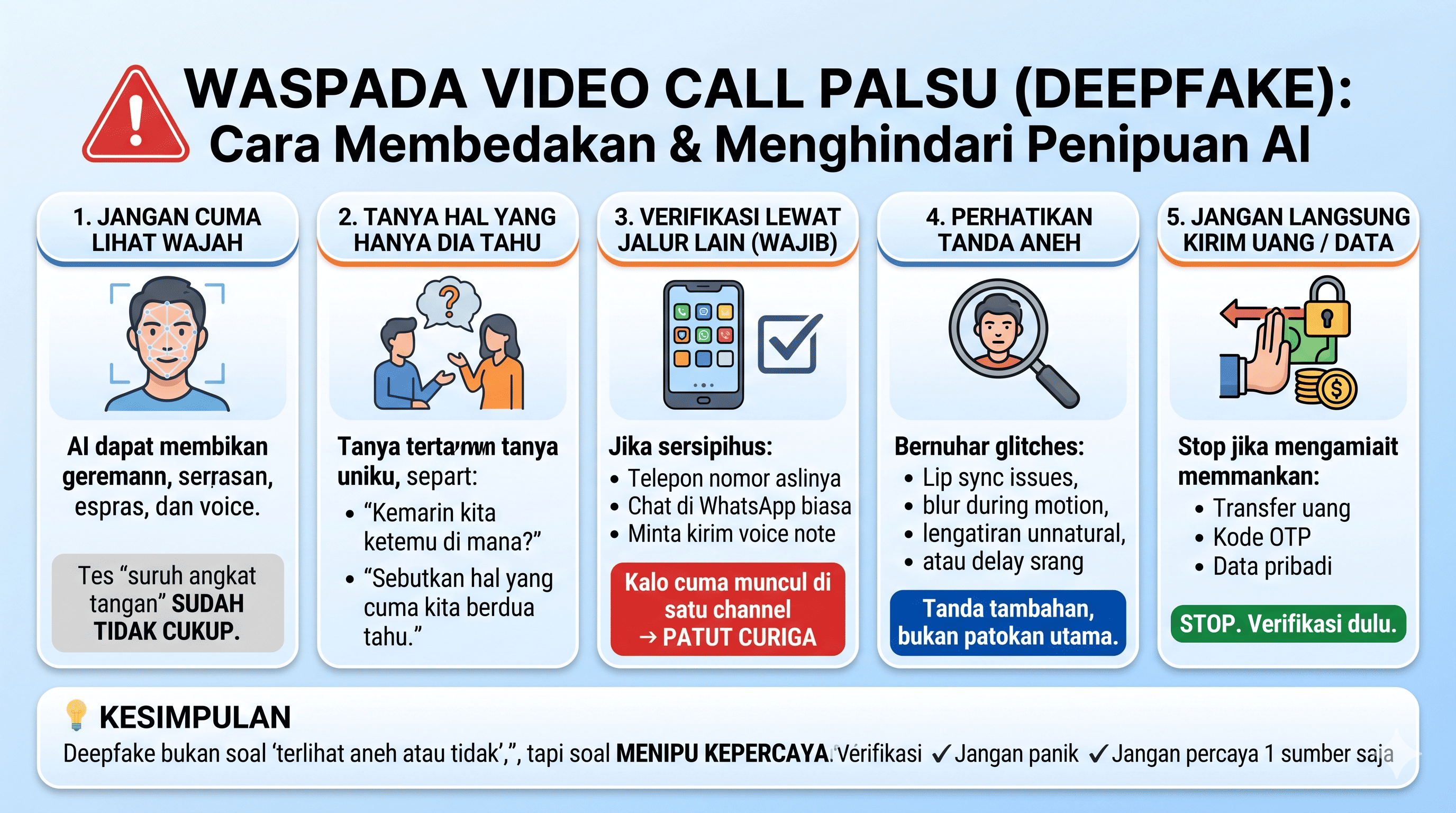

Penipuan berbasis deepfake tidak lagi sekadar rumor. Para pelaku kini mampu menduplikasi visual dan audio secara real-time, membuat tes sederhana seperti "coba lambaikan tangan" menjadi tidak relevan.

Mengapa Deepfake Berbahaya?

Teknologi saat ini memungkinkan AI untuk meniru ekspresi, gerak tubuh, hingga intonasi suara dengan tingkat akurasi yang mengerikan. Penipu menggunakan teknologi ini untuk membangun kepercayaan instan, biasanya dengan kedok situasi darurat yang membutuhkan transfer uang cepat atau data pribadi sensitif.

Protokol Keamanan: Cara Membedakan Asli vs Palsu

Agar tidak menjadi korban, masyarakat dihimbau untuk menerapkan protokol verifikasi berikut:

1. Uji Memori, Bukan Visual

Jangan terpaku pada kemiripan wajah. Berikan pertanyaan jebakan mengenai pengalaman pribadi yang hanya diketahui oleh Anda dan orang tersebut. Penipu mungkin memiliki data publik Anda, tapi mereka tidak memiliki histori emosional atau detail percakapan privat di masa lalu.

2. Wajib Verifikasi Multi-Kanal

Jika Anda menerima video call yang mencurigakan, segera tutup telepon tersebut. Lakukan verifikasi melalui jalur komunikasi lain:

- Hubungi nomor telepon seluler secara langsung (GSM).

Penipuan berbasis deepfake tidak lagi sekadar rumor. Para pelaku kini mampu menduplikasi visual dan audio secara real-time, membuat tes sederhana seperti "coba lambaikan tangan" menjadi tidak relevan.

Mengapa Deepfake Berbahaya?

Teknologi saat ini memungkinkan AI untuk meniru ekspresi, gerak tubuh, hingga intonasi suara dengan tingkat akurasi yang mengerikan. Penipu menggunakan teknologi ini untuk membangun kepercayaan instan, biasanya dengan kedok situasi darurat yang membutuhkan transfer uang cepat atau data pribadi sensitif.

Protokol Keamanan: Cara Membedakan Asli vs Palsu

Agar tidak menjadi korban, masyarakat dihimbau untuk menerapkan protokol verifikasi berikut:

1. Uji Memori, Bukan Visual

Jangan terpaku pada kemiripan wajah. Berikan pertanyaan jebakan mengenai pengalaman pribadi yang hanya diketahui oleh Anda dan orang tersebut. Penipu mungkin memiliki data publik Anda, tapi mereka tidak memiliki histori emosional atau detail percakapan privat di masa lalu.

2. Wajib Verifikasi Multi-Kanal

Jika Anda menerima video call yang mencurigakan, segera tutup telepon tersebut. Lakukan verifikasi melalui jalur komunikasi lain:

- Hubungi nomor telepon seluler secara langsung (GSM).

- Kirim pesan teks atau voice note melalui platform pesan instan yang berbeda.

- Jangan pernah percaya jika permintaan hanya muncul dari satu kanal komunikasi.

3. Perhatikan Detail Teknis (Glitch)

Meski semakin canggih, deepfake seringkali meninggalkan jejak digital yang tidak natural, antara lain:

- Jangan pernah percaya jika permintaan hanya muncul dari satu kanal komunikasi.

3. Perhatikan Detail Teknis (Glitch)

Meski semakin canggih, deepfake seringkali meninggalkan jejak digital yang tidak natural, antara lain:

- Sinkronisasi bibir (lipsync) yang tidak pas dengan suara.

- Efek blur atau bayangan aneh di sekitar wajah saat bergerak cepat.

- Pencahayaan wajah yang tidak konsisten dengan latar belakang.

Golden Rule: Stop, Think, Verify

Prinsip utama dalam menghadapi teknologi ini adalah jangan panik. Penipu mengandalkan rasa urgensi agar korban tidak sempat berpikir logis.

Prinsip utama dalam menghadapi teknologi ini adalah jangan panik. Penipu mengandalkan rasa urgensi agar korban tidak sempat berpikir logis.

Apapun alasannya—baik itu permintaan uang, kode OTP, atau data pribadi—selalu lakukan verifikasi ulang. Ingat, deepfake bukan soal kecanggihan visual, melainkan soal manipulasi kepercayaan. Jangan biarkan teknologi mengalahkan logika Anda.